Não se afoguem mais em uma tonelada de Logs, ELK te salva! (Real-time)

Hoje em dia a análise de Big Data é cada vez mais importante por uma série de fatores, um deles é a tomada de decisão sobre o que fazer com determinado produto, serviço ou aplicação e, por conta disso, quem não faz análise de seus logs acaba ficando para trás. Isso é válido para empresas, Sysadmins, engenheiros, e principalmente a galera DevOps. Com base nesta questão, este artigo mostra uma das muitas formas de fazer isso, utilizando de tecnologias como: ELK, Docker e outras ferramentas essenciais para uma Infraestrutura Ágil, tudo isso em Real-time.

[ Hits: 19.660 ]

Por: Uriel Ricardo em 18/10/2016

Configurando o Logstash.conf

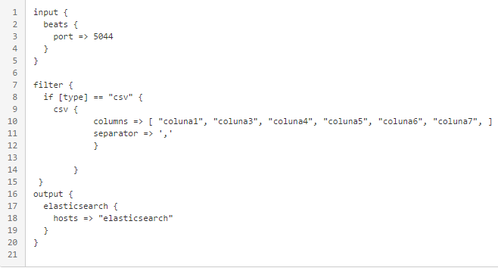

Para configurar o logstash, iremo acessar o diretório "./logstash" do repositório e abrir o arquivo "logstash.conf". Você vai ter algo como isso aqui: Podemos dividir essa configuração em 3 partes: input, filter e output.

Input

É a parte responsável pela entrada de dados, ali em nosso conf estamos dizendo que o input será o filebeat, tudo que entrar pela porta 5044 vai passar por ai, para depois cair no filter, para ser filtrado, como o próprio nome já diz. Uma dica legal quando for fazer o uso do filebeat remotamente é configurar além da porta o host, assim não sera qualquer um que poderá lhe enviar dados. Por exemplo:beats {

host => "xxx.xxx.xxx.xxx",

host => "yyy.yyy.yyy.yyy",

port => 5044

}

}

Neste caso só os hosts declarados acima poderiam injetar dados no Logstash, se um host "zzz.zzz.zzz.zzz" tentasse ele não teria sucesso. Outro modo de se fazer isso é ssl/tls!

Filter

Nessa parte tudo vai depender do motivo pelo qual você está tentando utilizar sua aplicação, no meu caso, vou utilizar a configuração da imagem porque esse é um dos modos mais fáceis de tratar um .csv, dividir ele em colunas, lembrando que será isso que vai aparecer no meu kibana.Na linha 8 estou dizendo que se o type que eu declarei lá no filebeat for = "csv" ele vai filtrar daquele modo! Caso eu tivesse analisando também dados de um nginx por exemplo, eu teria que fazer um "if" para ele e passar de que modo eu gostaria de filtrar os dados do nginx. Claramente estou usando o plugin csv do logstash.

A nível de produção estou usando uns 5 plugins só para este type, lembrando que existem dezenas de plugins (isso senão centenas!). Certo, digamos que nosso log esteja no .csv, e ele está dividido em colunas, como por exemplo: "origem", "receptor", "data", "status"... O log seria mais ou menos assim: "uriel@vivaolinux.com.br - adm@vivalinux.com.br - 30.09,16 - 'enviado com sucessso'....".

Em nosso filtro estou dividindo por colunas: "coluna1", "coluna3", "coluna4", "coluna5", "coluna6", "coluna7" que eu poderia ter nomeado como os dados do próprio .csv, "origem", "receptor", "data", "status"... Mas como disponibilizei o repositório para todos, este modo fica mais visível.

output

A saída é visivelmente o elasticsearc que será o responsável por armazenar estes dados depois de filtrados.Após configurar isso, terminamos, não é necessário configurarmos o kibana e o elasticsearch, pois as imagens que vamos usar, tem configuração padrão, basta sair do arquivo, e executar o comando:

# docker-compose up -d

e ele vai subir os containers.

Agora basta acessar o ip do seu host e a porta do kibana, exemplo: "111.111.111.111:5601".

Basta acessar, configurar um índice, e analisar seus dados.

Na próxima página vou mostrar algumas dashboards e visualizations.

2. Entendendo e configurando o Elk

3. Configurando o Filebeat.yml

4. Configurando o Logstash.conf

5. Acessando Kibana e analisando meu dados (Real-time)

Uma pequena jóia sobre ilusionismo visual

Slamd64 + ATI Radeon + AIGLX + Beryl

HairCAPTURE Utilizando captura de vídeo em C++ (sem segredos)

Teoria das Formas e o Aumento da Usabilidade

Parabéns pelo artigo, muito bem explicado! Achei você bem detalhista, lhe encontrei no LinkedIn, por acaso teria interesse em palestrar sobre isso na GDG DevFest em são Paulo?

E quanto ao artigo, teria este material em PDF?

Fantastico!

Especialista em Banco de Dados

[1] Comentário enviado por FelipeCoutinhoS em 19/10/2016 - 00:09h

Parabéns pelo artigo, muito bem explicado! Achei você bem detalhista, lhe encontrei no LinkedIn, por acaso teria interesse em palestrar sobre isso na GDG DevFest em são Paulo?

E quanto ao artigo, teria este material em PDF?

Olá Amigo, tudo bem? Lhe respondi na mensagem privada que me enviou, agradeço pelo feedback! Quanto ao pdf enviei para seu e-mail em anexo!

[2] Comentário enviado por cesar.dba em 20/10/2016 - 08:29h

Fantastico!

Especialista em Banco de Dados

Muito Obrigado pelo FeedBack =)

Assunto bem interessante. Obrigado pelo excelente artigo!

[5] Comentário enviado por eddye00 em 03/11/2016 - 09:22h

Assunto bem interessante. Obrigado pelo excelente artigo!

Eu que lhe agradeço, muito obrigador por ler meu artigo!

Amigo bom dia,

Poderia me enviar em pdf o artigo por e-mail?!

Especialista em Banco de Dados

Primeiramente você deve se preocupar em responder: o que é big data? Uma base grande? Grande quanto? Qual o maior gargalo em analisar big data? Como é feita a paralelização das análises?

Quando você conseguir responder estas perguntas, vai entender que não existe sentido em chamar logs gerados por um servidor de big data tal como não existe maneira de analisar uma base realmente grande em um único servidor. A maioria dos métodos de analise supõe que exista um driver (servidor ou pc aonde o código da análise é escrito) e vários workers (outros servidores que fazem a análise em paralelo). Métodos baseados no haboop tem um gargalo enorme (fora o problema da linguagem, só se pode usar Java), visto que existe muita leitura e escrita nos discos. Já frameworks mais novos, como o Apache Spark colocam toda a base a ser analisada em cache na memoria RAM, tornando as análizes até 100x mais rápidas que via hadoop. Além disto pode ser programado em Python, Scala, Java e R. Enfim, estou ilustrando este senário pois vejo muitos cursos de pós-graduação se propondo a abordar big data, porém o fazem de maneira totalmente equivocada, dando a impressão que qualquer base "grande" é big data.

Sei que seu propósito era apenas abordar alguns tools, porém gostaria de contribuir com estas reflexões.

Bom dia. Nobre amigo sigo todo o tutorial, mas não estou conseguindo encontrar esse comando docker-compose up -d. Poderia me ajudar? Fico no aguardo. Grato.

[9] Comentário enviado por iranmeneses em 05/05/2017 - 11:25h

Bom dia. Nobre amigo sigo todo o tutorial, mas não estou conseguindo encontrar esse comando docker-compose up -d. Poderia me ajudar? Fico no aguardo. Grato.

Tudo bem? você chegou a instalar o docker compose???

Patrocínio

Destaques

Artigos

Fscrypt: protegendo arquivos do seu usuário sem a lentidão padrão de criptograr o disco

Faça suas próprias atualizações de pacotes/programas no Void Linux e torne-se um Contribuidor

Como rodar o Folding@home no Linux

Criando um painel de controle (Dashboard) para seu servidor com o Homepage

O Abismo entre o Código e o Chão: Saltos Tecnológicos e a Exclusão Estrutural no Brasil

Dicas

Pisando no acelerador do Linux Mint: Kernel XanMod, zRAM e Ajustes de Swap

Como compilar kernel no Linux Mint

Lançamento do Brutal DOOM test 6

Consertando o erro no Brave de webgl

Solução para ter de volta as bordas e barra de títulos das janelas em zenity no Debian 13.x

Tópicos

Seno, Coseno, Tangente em CLIPPER (1)

Inserir uma URL num arquvo pelo Ubuntu (CLIPPER) (0)

VMWare Player não conecta na rede nem consigo intercambiar arquivos (1)

Top 10 do mês

-

Xerxes

1° lugar - 141.963 pts -

Fábio Berbert de Paula

2° lugar - 65.937 pts -

Buckminster

3° lugar - 45.669 pts -

Alberto Federman Neto.

4° lugar - 36.033 pts -

Sidnei Serra

5° lugar - 24.554 pts -

Alessandro de Oliveira Faria (A.K.A. CABELO)

6° lugar - 23.384 pts -

edps

7° lugar - 23.220 pts -

Daniel Lara Souza

8° lugar - 21.113 pts -

Mauricio Ferrari (LinuxProativo)

9° lugar - 20.544 pts -

Andre (pinduvoz)

10° lugar - 17.001 pts