Tutorial hadoop - Guia prático de um cluster com 3 computadores

Seu chefe disse que para aumentar o lucro da empresa é necessário criar um buscador de site (ex.: Google), ou seja, fazer uma pesquisa de forma eficiente em um arquivo com 10GB de tamanho por exemplo. Então conheça na prática como a ferramenta hadoop pode lhe ajudar.

[ Hits: 38.344 ]

Por: Ronaldo Borges em 21/12/2015 | Blog: https://www.facebook.com/ronyjah1

Descrição

Descrição resumida das principais ferramentas de cluster hadoop:

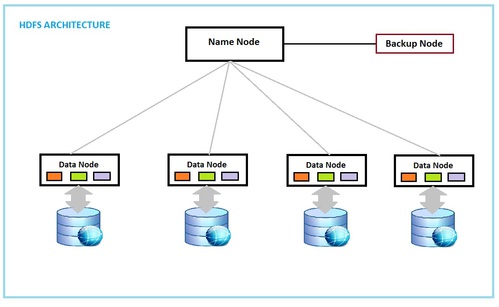

O sistema hadoop realiza duas tarefas básicas, dividir o arquivo a ser computado entre os nodos usando um sistema de arquivo próprio (ferramenta HDFS) e a outra tarefa é executar a aplicação nos nodos (ferramenta MapReduce ou Yarn). Nesta primeira parte trataremos da configuração do serviço HDFS.

Recursos necessários para montar o cluster:

- 1x computador mestre para rodar o namenode*

- 2x computadores escravos para datanode**

Obs.: O sistema também funcionará apenas com dois computadores (um namenode e um datanode).

* namenode é o principal elemento do sistema de arquivos do cluster, é o gerenciador do sistema de arquivos, monitora a saúde dos computadores escravos (datanodes), medindo os recursos de disco rígido e memória disponível. Tem a função de fragmentar o metadado em blocos e repassar para os datanotes. Lembrando que para aumentar a robustez contra falha nos nodos, os blocos sao replicados por 3 (configuração padrão).

Obs.: nos meus testes eu deixei em torno de 10 GB disponíveis no HD. Se não configurado, o hadoop irá alocar automaticamente o espaço disponível no seu HD para montar o sistema de arquivo DFS.

** datanode - o sistema criado pelo namenode é chamado HDFS. Ele basicamente cria blocos de 128 MB (config default) entre os computadores datanode. Conforme o tamanho do metadado a ser processado, mais blocos serão criados. Para aumentar a robustez do sistema o namenode replicará os dados do metadado aos datanodes do cluster.

Na imagem abaixo é possível ver a ilustração de sistema de arquivos HDFS. O metadado a ser computado por uma aplicação é dividido pelo namenode em blocos de 128 ou 64 MB enviados aos datanodes. Cada cor simboliza um bloco. As cores iguais entre os nodos representam a replicação dos dados para proteger a aplicação contra possíveis falhas em alguns dos nodos e a aplicação continue executando.

Este tutorial, foi implementado em sistema operacional Linux. Nas próximas paginas iremos descrever os principais componentes de configuração do cluster, arquivos de configuração, iniciação dos serviços e o exemplo de execução de uma aplicação contadora de palavras no cluster.

2. Configurando o ambiente nos computadores para receber o cluster hadoop

3. Instalação e configuração do hadoop

4. Iniciando o cluster hadoop

5. Testando o cluster Hadoop

6. Possíveis problemas

Tutorial - Aplicação em C para transferência de arquivo usando socket TCP e Thread

Instalando o oVirt 4.3 Single Host

Docker - Containers em Linux (parte 2)

Para fins de estudo e conhecimento o cenário proposto pelo artigo é valido. Em ambiente real não. Só pelo overhead gerado pelas tecnologias citadas mais a infraestrutura, a aplicação desta solução não vale a pena. O ecossistema Haddop deve preferencialmente ser usado quando REALMENTE o desafio de coleta, processamento e análise de dados demandam artilharia pesada! Deixo como sugestão a leitura desta apresentação e veja como problemas similares com um volume muito mais brutal de dados foram analisados usando apenas LINUX! http://slides.com/ronie/fbp_2015#/

[2] Comentário enviado por Lwkas em 28/12/2015 - 17:35h

Muito bom!

Fico agradecido por seu elogio, especialmente se este artigo for útil.

Cara, parabéns. Ótimo post de material riquíssimo.

Patrocínio

Destaques

Artigos

O Journal no Linux para a guarda e consulta de logs do sistema

A evolução do Linux e as mudanças que se fazem necessárias desde o seu lançamento

Maquina modesta - a vez dos navegadores ferrarem o usuario

Fscrypt: protegendo arquivos do seu usuário sem a lentidão padrão de criptograr o disco

Dicas

Discos que não instalam o sistema por erro MBR/GPT no Linux

Hospedagem de Mangás com Kavita e Docker para Acesso Remoto via Tailscale

Aplicar tema e ícones do Ubuntu Cinnamon no Arch Linux sem AUR

Tópicos

youtube não está funcionando no linux mint (2)

Instalação do driver Epson L3150 (1)

Continuando meus tópicos anteriores (4)

Top 10 do mês

-

Xerxes

1° lugar - 150.174 pts -

Fábio Berbert de Paula

2° lugar - 76.841 pts -

Buckminster

3° lugar - 47.511 pts -

Alberto Federman Neto.

4° lugar - 43.851 pts -

Alessandro de Oliveira Faria (A.K.A. CABELO)

5° lugar - 33.178 pts -

edps

6° lugar - 31.137 pts -

Sidnei Serra

7° lugar - 26.937 pts -

Mauricio Ferrari (LinuxProativo)

8° lugar - 24.536 pts -

Daniel Lara Souza

9° lugar - 22.998 pts -

Andre (pinduvoz)

10° lugar - 21.786 pts